"Wenn ich diesen Arm streichele, kann man auf dem Monitor - dort, wo ich streichele, wird die Grafik rot. Wenn ich ganz fest zudrücke, wird alles rot. Wenn ich den Arm gar nicht berühre, bleibt die Grafik blau. Das ist eine Visualisierung, die zeigt, wie die Daten aussehen."

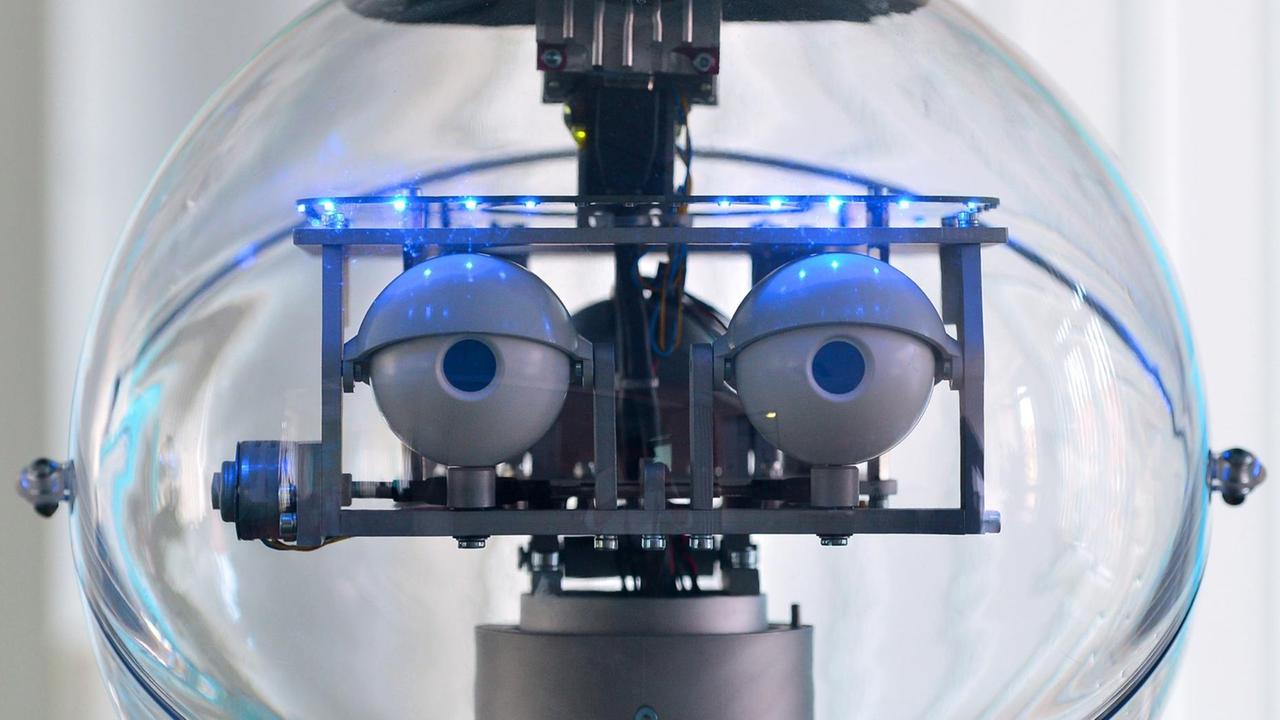

Merel Jung sitzt in ihrem Labor an der niederländischen Universität Twente und streichelt den Arm einer Schaufensterpuppe. Auf dem Unterarm befindet sich eine Manschette mit 64 Drucksensoren. Der Arm kann damit – so ähnlich wie ein menschlicher Arm – Berührungen wahrnehmen. Aber nicht nur das. Die Psychologin hat ihn genutzt, um einem Computersystem beizubringen, menschliche Berührungen zu verstehen.

"Die Testpersonen saßen vor dem Arm, so wie wir jetzt sitzen. Und auf dem Computerbildschirm bekamen sie Anweisungen. Zum Beispiel: Fest zugreifen! Und das taten sie dann. Oder: Sanft streicheln! Das Besondere war, dass sie sonst keine Informationen bekamen. So haben wir eine große Datenbank von sozialen Berührungen zusammenbekommen."

Charakteristische Eigenschaften von Berührungen berechnen

Insgesamt 31 Personen kratzten, schlugen, kitzelten oder rieben den künstlichen Arm. 14 solcher Interaktionen sollte jeder auf seine ganz persönliche Art ausführen.

"Daraus konnten wir charakteristische Eigenschaften mancher Berührungen berechnen. Zum Beispiel die Veränderung der Kontaktfläche der Hand: Beim Streicheln bewegt die sich. Bei einem Griff ist sie statisch. Und mit diesen Eigenschaften haben wir einem Algorithmus beigebracht, die Gesten zu unterscheiden."

Es ist kein Zufall, dass Merel Jung gerade jetzt erforscht, wie man mit Robotern über Berührungen kommunizieren kann. Schließlich kommen die Maschinen uns immer näher.

"Früher waren Roboter noch gefährlich und man durfte nicht zu nah an sie ran, etwa in Fabriken. Aber jetzt kann man sie anfassen. Und Berührungen sind ein Signal, das man nutzen könnte. Profitieren könnten etwa Menschen, die sich kein Haustier zulegen können. Die könnten ein Roboter-Haustier haben. Oder Roboter in der Pflege, die Menschen unterstützen. Und wenn man mit Robotern arbeitet und man einfach sagen will: "Aus dem Weg!" Dann könnten Berührungen auch wichtig sein."

Gesten werden in 60 Prozent der Fälle korrekt erkannt

Reine Hinderniserkennung beherrschen viele Roboter heute schon und können Menschen so aus dem Weg gehen. Doch wirklich verstehen können sie Berührungen noch nicht. Das System von Merel Jung ist auch noch lange nicht perfekt. Es erkennt die Gesten in 60 Prozent der Fälle korrekt. Klingt nach nicht viel, ist aber beachtlich, wenn man bedenkt, wie kompliziert für uns selbstverständliche Berührungen in Wirklichkeit sind.

"Ich persönlich achte jetzt viel starker auf Berührungen. Und ich denke: "Woher weiß ich, was die Menschen damit meinen?" Aus irgendeinem Grund versteht man Berührungen einfach. Ich weiß nicht so recht, wie Menschen das machen. Umso schwerer ist es, das einer Maschine beizubringen."

Damit das besser klappt, hat Merel Jung ihre Daten anderen Forschern zur Verfügung gestellt. So können die ihre eigenen Algorithmen trainieren. Derzeit versucht die Psychologin, weitere Informationen darüber zu sammeln, wie Menschen mit Maschinen kommunizieren: Sie beobachtet, wie Testpersonen mit einem künstlichen Haustier umgehen. So gewinnt sie weitere Einblicke, die Maschinen irgendwann dabei helfen könnten, uns Menschen besser zu verstehen.