Manfred Kloiber: Fangen wir mal mit der Prozesskontrolle an. Die bisherigen Angriffstechniken beruhen ja alle auf der recht simplen Idee, dass eine Programmfunktion manipuliert werden kann, um zu einem Schadcode zu verzweigen. Wie würden solche Angriffe nach diesem neuen Paradigma verhindert werden?

Peter Welchering: Durch eine Art Trusted-Computing-Konzept für Prozesse. Wenn aus dem Quellprogramm Maschinencode erzeugt wird, fertigt der Compiler eine Tabelle an, in der genau steht, von welchem Softwaremodul in welches Softwaremodul gesprungen wird. Verzweigt eine Programmfunktion, wird sie nur freigegeben, wenn der Verzweigungssprung durch diese Tabelle autorisiert ist. Und zweitens wird jede Programmfunktion erst dann gestartet, wenn sie sich beim Sicherheitsbetriebssystem mit einer digitalen Signatur ausgewiesen hat.

Kloiber: Würde das die Systeme in Sachen Geschwindigkeit nicht ziemlich ausbremsen?

Welchering: Die Forscher sagen, dass tatsächlich ein Overhead von ungefähr 30 Prozent entstehen würde. Den könnte man aber sogar durch entsprechende Programmierung für Echtzeitanwendungen auffangen.

Kloiber: Wäre das dann auch in Industrie-4.0-Umgebungen einsetzbar?

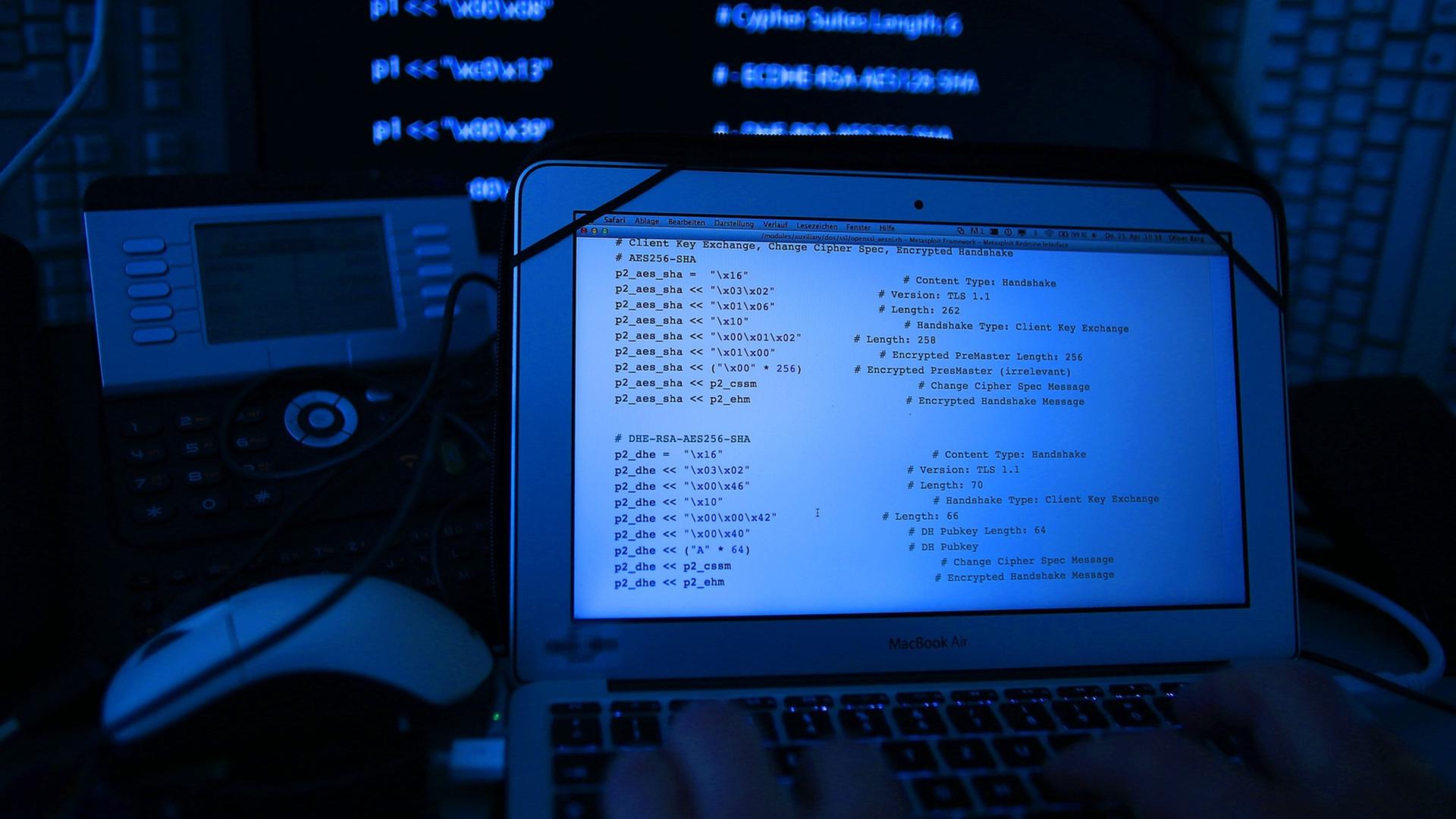

Welchering: Da müssten ein paar Voraussetzungen erfüllt sein. Eine der Voraussetzungen wäre, stärker mit verschlüsselter Kommunikation auch in Produktionsumgebungen zu arbeiten. Hier läuft der Datenaustausch oft noch unverschlüsselt ab. Eine weitere Voraussetzung besteht darin, Zertifikatestrukturen für digitale Signaturen umfassend einzuführen. Da ist Deutschland noch ziemlich Entwicklungsland. Und die dritte Voraussetzung besteht darin, sehr gezielt nach Sicherheitslücken zu suchen und sie zu schließen. Diese Voraussetzung stößt den Politikern am heftigsten auf. Da werden sie nämlich von ihren Nachrichtendiensten unter Druck gesetzt, dass die solche Sicherheitslücken für ihre Arbeit brauchen. Und das Zauberwort heißt natürlich Terrorabwehr.

Kloiber: Das Problem liegt doch auch immer darin, dass der Prozesskontrolleur auch noch einmal kontrolliert werden muss.

Welchering: Ja, und da kann man dann natürlich zu unendlich komplexen Systemen kommen. Um das zu vermeiden, ist eine genaue Funktionskontrolle nötig. Also: Die Tabelle mit den Sprunganweisungen wird vom Compiler erstellt. Also muss dessen Funktion überprüft sein. Die digitale Signatur, mit der sich ein Prozess zum Start ausweist, muss über ein Zertifikat gegengeprüft werden. Also muss die Stelle, von der das Zertifikat stammt, überprüft werden. Wenn man das auf diese konkreten Funktionen beschränkt, bleibt die Komplexität im Rahmen.

Kloiber: Haben die Teilnehmer aus dem politischen Bereich, die den BSI-Kongress besucht haben, diese Ansätze überhaupt zur Kenntnis genommen.

Welchering: Die sind vorher abgefahren. Und das ist natürlich sehr schade. Peter Liggesmeyer hat etwa nach Innenminister Thomas de Maizière seinen Vortrag gehalten zur Eröffnung des Kongresses und dabei auch die Ergänzung von Zugriffskontrolle um Nutzungskontrolle deutlich gemacht. Da hat sich aber gerade zu diesem Zeitpunkt de Maizière verabschiedet. Und das ist ein wesentliches Problem, das die Politik hat. Sie beschließt ein von Juristen ausgearbeitetes IT-Sicherheitsgesetz. Die technischen Kompetenzen, die erforderlich sind, um solch ein Gesetz auf den Weg bringen zu können, fehlen weitgehend.

Kloiber: Woran liegt das?

Welchering: Technik gilt vielen Politikern als zu kompliziert. Und dann wird gern ein völlig schräger Gegensatz aufgemacht. De Maizière brachte in Bad Godesberg seine Lateinkenntnisse in Stellung gegen technische Kenntnisse. Nichts gegen Latein. Aber genau solch eine Haltung verhindert den breiten gesellschaftlichen und politischen Diskurs über die Techniken, die wir haben wollen, und wie wir sie sicher machen wollen. Wir klassischen Bildungsbürger wollen uns damit nicht auseinandersetzen. Das sollen die Jungs im Maschinenraum tun. Und wir lassen sie dabei von unseren Sicherheitsbehörden kontrollieren. Genau das Modell funktioniert aber in einer Informationsgesellschaft nicht mehr.