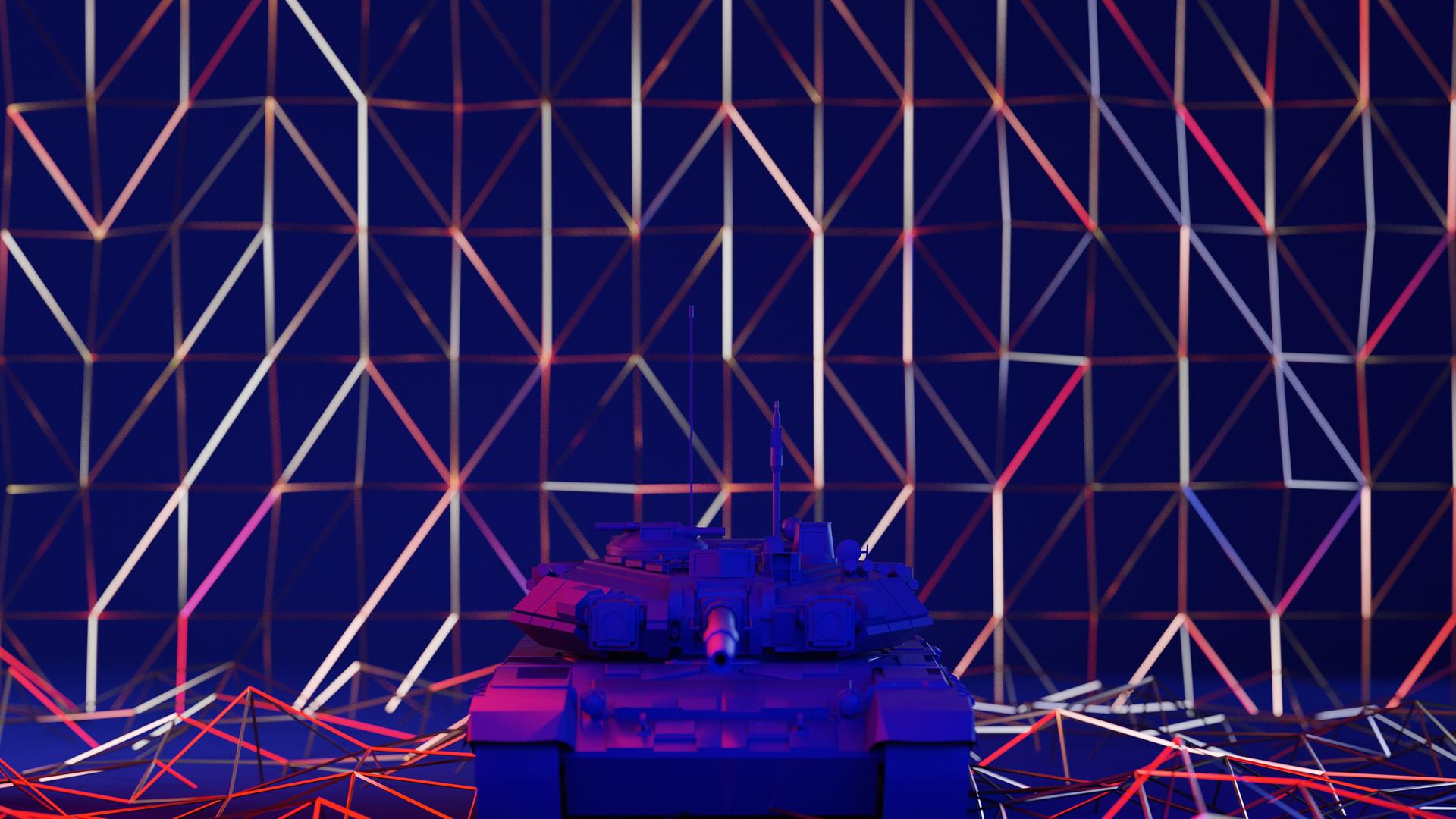

KI und Konfliktlösung

ChatGPT schürt Aggression bei Konflikten in Kriegsspielen

KI-Sprachmodelle zeigen bei Szenarien in Kriegsspielen mehr Aggressivität als der Mensch, fand Forscher Max Lamparth heraus. Er fordert den militärischen Einsatz von Chatbots zu verbieten, solange bestimmte Sicherheitskriterien nicht erfüllt sind.